Navigieren durch KI-Dilemmas: Datenschutz, Sicherheit und Fairness

Künstliche Intelligenz verändert unser tägliches Leben und unsere Arbeitswelt tiefgreifend. Während sie enorme Potenziale birgt, sind mit der Einführung von KI-Technologien auch neue Dilemmas verbunden, insbesondere in den Bereichen Datenschutz, Sicherheit und Fairness. Es ist unerlässlich, diese Herausforderungen bewusst zu adressieren, um das Vertrauen von Nutzern zu festigen und langfristig nachhaltige Fortschritte zu gewährleisten. Auf dieser Seite beleuchten wir zentrale Aspekte, die beim Navigieren durch die aktuell wichtigsten KI-Dilemmas zu beachten sind, und zeigen Wege zu einem verantwortungsvollen Umgang mit Künstlicher Intelligenz auf.

Datenschutz in der Ära der Künstlichen Intelligenz

Ein Großteil der Unsicherheiten hinsichtlich KI und Datenschutz ergibt sich aus mangelnder Transparenz über die Art und Weise, wie Daten gesammelt, verarbeitet und gespeichert werden. Nutzer verlangen nach eindeutig kommunizierten Informationen über den Umgang mit ihren Daten. Transparente Datennutzung schafft Vertrauen und ermöglicht es Menschen, informierte Entscheidungen zu treffen. Unternehmen und Institutionen stehen daher in der Pflicht, nicht nur gesetzlichen Anforderungen wie der DSGVO zu genügen, sondern auch nachvollziehbar zu machen, wie KI-Systeme mit personenbezogenen Daten umgehen. Die Offenlegung von Prozessen und Algorithmen im Kontext der Datennutzung stellt hierbei einen entscheidenden Schritt dar, um Missbrauch und unbeabsichtigte Konsequenzen frühzeitig zu erkennen und zu vermeiden.

Schutz vor Cyberangriffen und Manipulation

KI-Systeme sind für Cyberkriminelle ein lohnenswertes Ziel: Angreifer versuchen, Schwachstellen auszunutzen, um KI-Modelle zu manipulieren oder vertrauliche Daten auszulesen. Besonders Angriffe wie „Data Poisoning“ oder „Model Inversion“ stellen erhebliche Gefahren dar. Die kontinuierliche Überprüfung und Verbesserung von Sicherheitsarchitekturen ist daher unverzichtbar. KI-Entwickler stehen in der Verantwortung, robuste Abwehrmechanismen gegen bekannte und neue Bedrohungsszenarien einzubauen. Gleichzeitig sollten regelmäßige Security-Audits und Penetrationstests durchgeführt werden, um potenzielle Schwachstellen frühzeitig zu identifizieren. So kann die Betriebssicherheit gewährleistet und das Vertrauen in KI-Lösungen nachhaltig gestärkt werden.

Zuverlässigkeit und Robustheit sicherstellen

KI-Technologien müssen nicht nur sicher, sondern auch zuverlässig und robust agieren, ganz besonders in sicherheitskritischen Anwendungsbereichen wie dem Gesundheitswesen oder der Mobilität. Fehlerhafte Entscheidungen einer KI oder Systemausfälle können gravierende Folgen haben. Deshalb ist es entscheidend, dass Algorithmen und Datenquellen kontinuierlich überwacht und getestet werden. Robustheit bedeutet auch, dass Systeme in der Lage sind, ungewöhnliche oder unvorhergesehene Situationen zu erkennen und angemessen darauf zu reagieren. Sicherheitsmechanismen, Fail-Safes und automatisierte Überwachungstools tragen dazu bei, die Integrität und Berechenbarkeit von KI-Anwendungen dauerhaft zu gewährleisten.

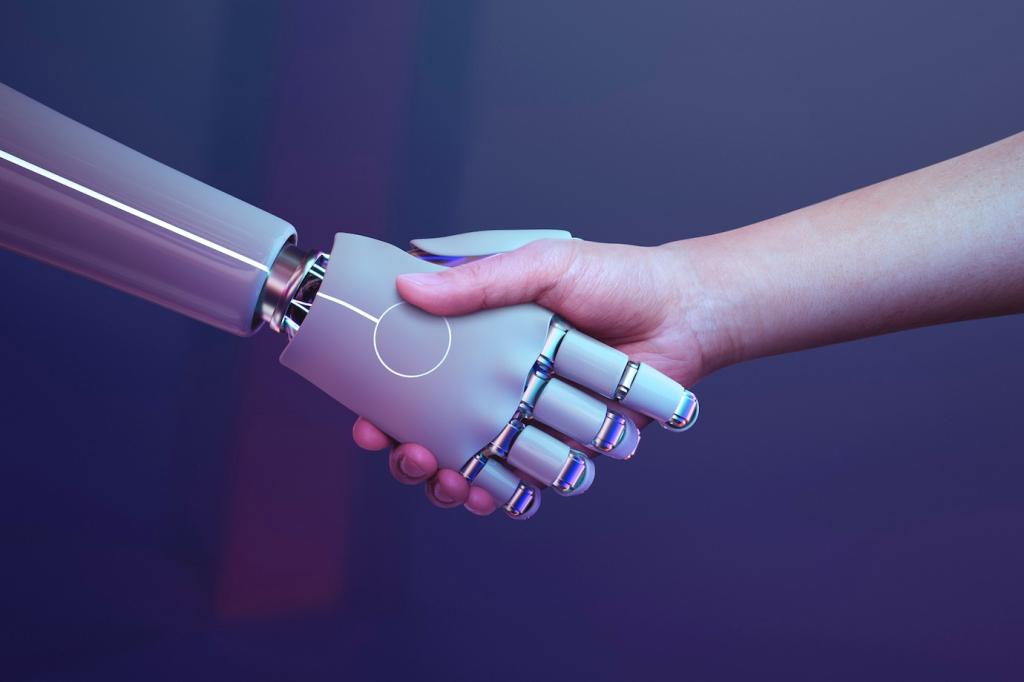

Verantwortung und Haftung im Schadensfall

Mit dem Einsatz von KI-Systemen treten neue Fragen hinsichtlich der Verantwortlichkeit und Haftung auf. Wer trägt die Konsequenzen, wenn durch einen Fehler einer künstlichen Intelligenz Personen geschädigt werden oder materielle Verluste entstehen? Gesetzgeber, Unternehmen und Entwickler müssen klare Regularien schaffen, die im Schadensfall greifen. Neben technischen Lösungen wie Auditing und Nachvollziehbarkeit sind rechtliche Rahmenbedingungen ebenso relevant. Nur so kann das Haftungsrisiko angemessen verteilt werden, und Betroffene erhalten Sicherheit, dass sie im Fall eines Schadens nicht schutzlos sind. Verantwortung und Transparenz gehen hier Hand in Hand, um ein stabiles und gerechtes KI-Ökosystem zu fördern.

Fairness und Gerechtigkeit in KI-Entscheidungen

Eines der größten Risiken bei KI-Anwendungen besteht darin, dass die Algorithmen unbeabsichtigt Vorurteile und Diskriminierung reproduzieren oder sogar verstärken. Wenn Trainingsdaten einseitig oder unvollständig sind, können Maschinen Entscheidungen treffen, die bestimmte Bevölkerungsgruppen benachteiligen. Daher ist es unerlässlich, die verwendeten Datensätze und Modelle kritisch zu überprüfen und auf mögliche Verzerrungen zu testen. Auch die kontinuierliche Anpassung der Algorithmen ist notwendig, um faire und objektive Entscheidungsprozesse sicherzustellen. Nur durch gezielte Maßnahmen können Unternehmen gewährleisten, dass KI-Systeme als Werkzeuge für mehr Gerechtigkeit und nicht als Verstärker bestehender Diskriminierung wirken.

Previous

Next